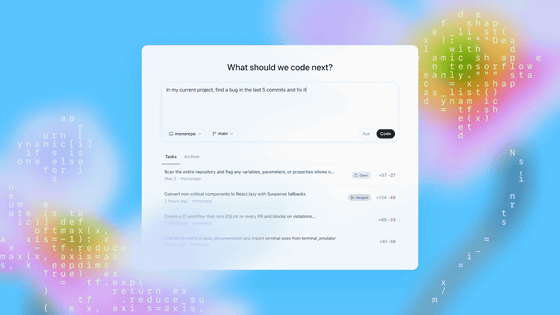

OpenAIが脆弱性の発見・検証・修正を自動化するAIエージェント「Codex Security」を発表

OpenAIがコードのセキュリティレビューを自動化するAIエージェント「Codex Security」を発表しました。他のエージェントツールでは見逃されてしまうような複雑な脆弱(ぜいじゃく)性も特定し修正案を提示することが可能で、システムのセキュリティを大幅に向上させられるとしています。

Codex Security: now in research preview | OpenAI

https://openai.com/index/codex-security-now-in-research-preview/

We're introducing Codex Security.

— OpenAI Developers (@OpenAIDevs) 2026年3月6日

An application security agent that helps you secure your codebase by finding vulnerabilities, validating them, and proposing fixes you can review and patch.

Now, teams can focus on the vulnerabilities that matter and ship code faster.… pic.twitter.com/t45Wkm7Rda

OpenAIによると、実際のセキュリティリスクを評価するにはコンテキストが不可欠ですが、ほとんどのAIセキュリティツールは影響度の低い検出結果や誤検知のみをフラグ付けするため、フラグを検証するために人間のセキュリティチームが多大な時間を費やす必要があったそうです。同時に、AIでソフトウェア開発が加速する中で、セキュリティレビューは加速が難しく重要な問題となっていました。このような問題に対処するため、OpenAIは2025年10月に「人間のようにコードを読んでセキュリティ対策を行う」というAIエージェント「Aardvark」を発表しました。

OpenAIがGPT-5ベースの脆弱性検知ツール「Aardvark」を発表、OpenAI社内ではすでに稼働中 - GIGAZINE

AardvarkはOpenAIの社内で稼働していたほか、プライベートベータ版として少数のユーザーを対象に開始されました。ベータ版の期間中にノイズを低減し、重大度の精度を改善し、誤検知を減らしたことで、検出結果の品質も大幅に向上しました。そのAardvarkの進化版として登場したのがCodex Securityです。

Codex Security began as Aardvark, launched last year in private beta.

— OpenAI Developers (@OpenAIDevs) 2026年3月6日

Since then, we’ve significantly improved signal quality, reducing noise, improving severity accuracy, and lowering false positives, so findings better align with real-world risk. https://t.co/nGbXV5leVY

Codex SecurityはOpenAIの最先端AIモデルによる推論とCodexエージェントによる自動検証を組み合わせることで、信頼性の高い検出結果と実用的な修正を提供するとのこと。Codex Securityの特徴は以下の通り。

・システムの構造を理解し脅威モデルを自動作成

スキャンを設定すると、リポジトリを解析してシステムの構造やセキュリティ上重要なポイントを理解します。その上で「システムが何をしているのか」「どこを信頼しているのか」「どこが攻撃されやすいのか」を整理したプロジェクト専用の脅威モデルを自動生成します。この脅威モデルはユーザーが編集することもできるため、エージェントとチームを連携させながら調整できます。

・脆弱性を優先度付きで検出し実際に問題か検証

作成した脅威モデルをもとにコードを調査し、脆弱性を検出します。検出した問題が実際のシステムでどれくらい影響があるかを基準に優先度を付け、可能な場合はサンドボックス環境で検証を行い「本当に問題なのか(誤検知ではないか)」を確認します。この詳細な検証により、誤検知を削減し、実用的な概念実証(PoC)も生成できるため、セキュリティチームはより強力な証拠とより明確な修復手順を得ることができます。

・システム全体の文脈を理解した修正案を提示

発見された脆弱性に対して、Codex Securityはシステムの設計意図や周囲のコードとの関係を考慮した修正案を提示します。これにより、セキュリティを強化しつつ既存機能を壊す「回帰バグ(リグレッション)」を最小限に抑えた修正が可能になります。また、ユーザーは結果をフィルタリングして、重要度の高い問題に集中することができます。

OpenAIによると、Codex Securityはベータコホートにおいて外部リポジトリ全体で120万件以上をスキャンし、792件の重大な発見事項と1万561件の比較的重大度の高い発見事項を特定したとのこと。「重大な問題」と分類されたのは0.1%未満であり、「大量の問題を検出してレビュー担当者への負担が増える」という問題を最小限に抑えることができることを示しているそうです。OpenAIは「開発チームは重要な脆弱性に集中し、安全なコードをより迅速にリリースできるようになります」と述べています。

実際にCodex Securityを使用した開発者のショーン・モリアーティ氏は「うちのコードベースで実行した結果、24時間かけて約5000のコミットをスキャンして、275件の問題を発見しました。すでにCodex Securityが提案した修正を15個コードに採用しましたが、ほとんど修正なしでそのまま使用できました。Codex Securityの作成した脅威モデルは非常に正確かつ詳細で、検出の精度も非常に高いと感じています。全ての結果の検証が終わったら、正確な統計も共有する予定です」と高い評価をしています。

We (@get_mocha) got access to this and ran it on our codebase yesterday. It took ~24 hours and scanned almost 5000 commits, and found 275 issues. I’ve merged 15 codex suggested PRs so far (most of which required zero iteration) and am working my way through the rest the rest of… https://t.co/kC7ajO07O4

— Sean Moriarity (@sean_moriarity) 2026年3月6日

Codex Securityは、ChatGPT Enterprise、Business、Edu、ChatGPT Proのユーザー向けに研究プレビューとして提供開始され、2026年4月には無料で利用可能になる予定です。

・関連記事

「Claude Code Security」が登場、コード内の脆弱性をスキャンして修正提案もしてくれる - GIGAZINE

OpenAIがGPT-5ベースの脆弱性検知ツール「Aardvark」を発表、OpenAI社内ではすでに稼働中 - GIGAZINE

OpenAIがコーディング特化のAIモデル「GPT-5.2-Codex」をリリース - GIGAZINE

OpenAIが「GPT-5.4」をリリース、人間より上手にPCを操作できる「エージェント性能に優れた最も有能で効率的なフロンティアモデル」 - GIGAZINE

「GPT-5.3 Instant」が登場、ChatGPTの余計な前置きが減ってウェブ検索機能も強化される - GIGAZINE

・関連コンテンツ

in AI, セキュリティ, Posted by log1e_dh

You can read the machine translated English article OpenAI Announces Codex Security, an AI A….