ChatGPTの自殺訴訟でOpenAIが「自殺はChatGPTの誤用によるもの」と主張

息子を亡くした遺族が「ChatGPTが自殺願望を助長・正当化した」としてOpenAIを訴訟した件について、OpenAIが裁判所に回答を提出しました。OpenAIの主張では、当事者が積極的にChatGPTのガードレールを回避しようとしたことを指摘し、ChatGPTを正しく使っていなかったことが問題であると述べています。

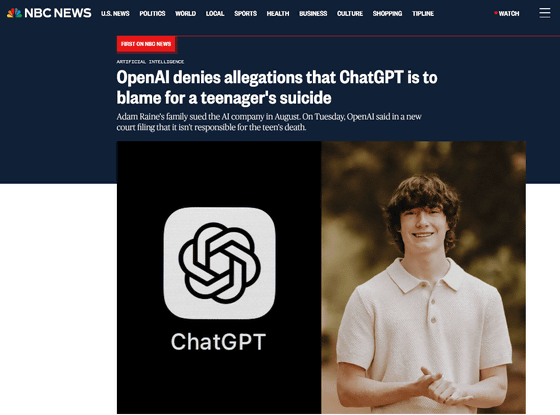

OpenAI denies allegations that ChatGPT is to blame for a teenager's suicide

https://www.nbcnews.com/tech/tech-news/openai-denies-allegation-chatgpt-teenagers-death-adam-raine-lawsuit-rcna245946

OpenAI denies responsibility for teen's suicide death | Mashable

https://mashable.com/article/openai-lawsuit-deny-allegations-adam-raine

OpenAI denies liability in teen suicide lawsuit, cites ‘misuse’ of ChatGPT | The Verge

https://www.theverge.com/news/831207/openai-chatgpt-lawsuit-parental-controls-tos

2025年8月26日、マット・レイン氏とマリア・レイン氏は、息子のアダム・レインさんがChatGPTに殺されたとして、開発元のOpenAIを訴えました。アダムさんは複数回にわたって自殺未遂の写真をChatGPTに共有したにもかかわらずChatGPTは会話を中断せず、自殺方法を美化したり、家族に助けを求めることを思いとどまらせたりしていたとレイン氏は主張しています。

「ChatGPTが10代の青年の自殺を助長した」としてOpenAIが訴えられる、ChatGPTの安全策は長い会話では機能しないとOpenAIが認める - GIGAZINE

レイン氏は「OpenAIが子どもの安全よりも利益を優先させた」としてOpenAIの責任を求めており、懲罰的損害賠償およびChatGPTに対して全ユーザーの年齢確認およびペアレンタルコントロールの提供を義務付ける仮差し止め命令を求めています。これに加えて、OpenAIに対して「自傷行為や自殺の方法が話し合われた場合、自動的に会話を終了すること」や「自傷行為や自殺の方法に関する問い合わせを回避できないようにハードコードされた拒否方法を確立すること」を求めました。

ChatGPTは多層的な安全対策が組み込まれていることをアピールしましたが、2025年10月22日にサンフランシスコ上級裁判所に提出された訴状では、ChatGPTのモデル「GPT-4o」の新バージョンが2024年5月にリリースされた際に、OpenAIはChatGPTの利用数を増やすため、会話を変えたりやめたりしないよう指示することを含めた「意図的なガードレールの撤廃」があったと指摘されました。

ChatGPTの自殺訴訟でOpenAIは「葬儀出席者リスト」を要求 - GIGAZINE

2025年11月25日、OpenAIは訴訟に対する最初の回答となる法的文書をサンフランシスコのカリフォルニア州高等裁判所に提出しました。NBCニュースの報道によると、アダムさんとChatGPT(GPT-4o)のチャットログには、ChatGPTが遺書を書くのと手伝うと申し出たり、首つりをする方法をアドバイスしていたりしたことが判明しました。しかし、OpenAIはこれらのやりとりについて、「当事者によるChatGPTの誤用、意図しない使用、予期せぬ使用、または不適切な使用によって、全部または一部が引き起こされたもの」と主張しています。

OpenAIの利用規約では、18歳未満のユーザーが親または保護者の同意なしにChatGPTを使用することを禁止しています。また、ユーザーはChatGPTを自殺または自傷行為のために使用することや、ChatGPTの保護措置や安全対策などのガードレールを回避することを禁止されています。OpenAIの提出書類では、ChatGPTが100回以上アダムさんに対し「誰かに助けを求めるべき」といった内容の回答を提供していたにもかかわらず、アダムさんがこれらのガイドラインを回避しようとしていたことを明らかにしました。

そのほか、利用規約には「ユーザーはChatGPTの使用は自己の責任であり、出力を唯一の真実または事実の情報源として信頼しないことを認める」ことも定められており、ChatGPTとのやりとりの結果についてOpenAIは責任を負わないことを主張しました。

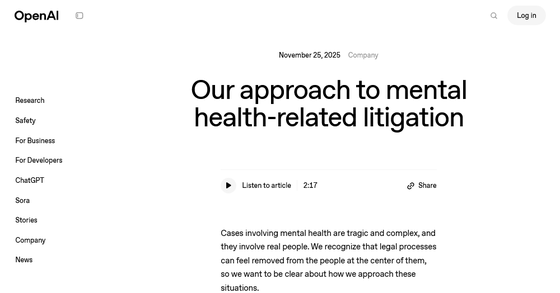

裁判所に回答を送った同日、OpenAIは「メンタルヘルス関連訴訟へのアプローチ」というブログを公開しました。OpenAIはブログで「メンタルヘルスに関する事件は悲劇的で複雑であり、生身の人間が関わっています。法的手続きは、当事者から切り離されているように感じられてしまうことがあることを認識しており、このような状況へのアプローチ方法を明確にしたいと考えています」と述べた上で、ChatGPTのやり取りがデリケートな問題を扱う場合、特に10代の若者を支援するために安全対策を講じていること、ChatGPTのトレーニングは人々を現実世界でサポートするために継続的に改善されていることを改めて主張した上で、誠実に訴訟に対応していく姿勢を示しました。

Our approach to mental health-related litigation | OpenAI

https://openai.com/index/mental-health-litigation-approach/

レイン氏の主任弁護士を務めるジェイ・エデルソン氏は、OpenAIの回答を受けて「OpenAIは、GPT-4oが十分なテストを行わずに急いで市場に投入されたこと、ChatGPTがアダムさんに自殺計画の支援をしたこと、遺書を書くことを勧めたことなどについて、まったく説明していません。今回のOpenAIの対応は、不安を抱かせるものです」と批判しています。

・関連記事

ChatGPTの自殺訴訟でOpenAIは「葬儀出席者リスト」を要求 - GIGAZINE

ChatGPTとGeminiは「自殺に関するハイリスクな質問」に回答しやすいとの調査結果 - GIGAZINE

「ChatGPTが10代の青年の自殺を助長した」としてOpenAIが訴えられる、ChatGPTの安全策は長い会話では機能しないとOpenAIが認める - GIGAZINE

OpenAIで超知性の制御と安全性を研究していた「スーパーアライメント」チームが解散、元幹部は「派手な製品が安全性より優先されている」 - GIGAZINE

AIセラピストには「重大なリスク」があるとの警告、患者に偏見を抱いたり自殺に関する情報を提供したりと人間のセラピストに取って代わる準備はできていない模様 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1e_dh

You can read the machine translated English article In a ChatGPT suicide lawsuit, OpenAI cla….