OpenAIいわく「毎週100万人以上がChatGPTで自殺について話している」

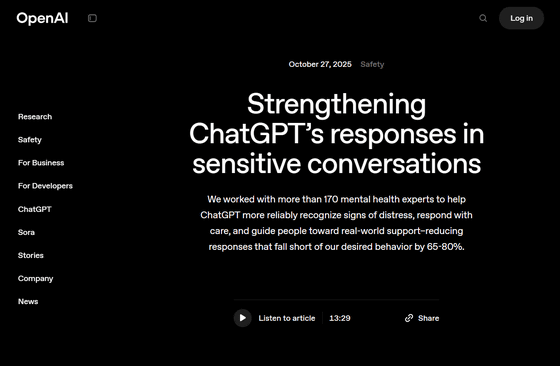

現地時間の2025年10月27日、OpenAIが自殺や自傷行為などのデリケートな会話におけるChatGPTの対応強化を発表しました。OpenAIによると、対策を強化する前のタイミングでは週に100万人以上がChatGPTに対して自殺について相談していたことも明らかになっています。

Strengthening ChatGPT’s responses in sensitive conversations | OpenAI

https://openai.com/index/strengthening-chatgpt-responses-in-sensitive-conversations/

OpenAI says over a million people talk to ChatGPT about suicide weekly | TechCrunch

https://techcrunch.com/2025/10/27/openai-says-over-a-million-people-talk-to-chatgpt-about-suicide-weekly/

OpenAIは臨床経験を持つメンタルヘルスの専門家と協力し、AIモデルがユーザーの苦悩をより良く認識し、会話を落ち着かせ、適切な場面で専門家のケアへと導くよう学習させてきました。この新しいAIモデルはChatGPTのデフォルトモデルとして採用されたばかりです。OpenAIは危機ホットラインへのアクセスを拡大し、他のAIモデルからより安全なAIモデルへの繊細な会話が削除され、長時間のセッション中に休憩を取るよう優しく促すリマインダーが追加されました。

ChatGPTは人々が自分の気持ちを整理し、適切なタイミングで友人、家族、またはメンタルヘルスの専門家に相談するための支援的な場を提供できると主張しています。最近のモデルアップデートにおける安全性の向上は、以下の領域に重点を置いています。

1:精神病やそう病などのメンタルヘルスに関する懸念

2:自傷行為と自殺

3:AIへの感情的な依存

なお、OpenAIは「今後は長年にわたって実施してきた自殺と自傷行為に関するベースライン安全性指標に加え、感情的な依存と自殺を伴わないメンタルヘルスの緊急事態を、将来のAIモデルリリースに向けた標準ベースライン安全性テストに追加していきます」と説明しています。

OpenAIはChatGPTの応答を改善するための方法として、以下の5つを挙げました。

・問題を定義

さまざまな種類の潜在的な問題をマッピングします。

・測定を始める

実際の会話やユーザー調査などのツールを使用して収集したデータを評価し、リスクがどこでどのように発生するかを理解します。

・アプローチを検証

外部のメンタルヘルスおよび安全の専門家と協力し、OpenAIの定義とポリシーを確認します。

・リスクを軽減

モデルを事後トレーニングし、製品の介入を更新して、安全でない結果を減らします。

・測定と反復を継続

緩和策によって安全性が向上したことを検証し、必要に応じて反復します。

このプロセスの一環として、OpenAIは「タクソノミー」と呼ばれる詳細なガイドを構築・改良していきます。これは、センシティブな会話の特性と、理想的なAIモデルの動作と望ましくないAIモデルの動作を解説するものです。これにより、AIモデルがより適切な対応をするように学習し、導入前後のパフォーマンスを追跡することができます。その結果、精神病、そう病、自殺念慮や自傷行為、あるいはモデルへの不健全な感情的執着の兆候を示すユーザーに対し、より確実に適切な対応ができるAIモデルが開発できるそうです。

メンタルヘルスの症状や精神的苦痛は人間社会に普遍的に存在し、ユーザーベースの増加に伴い、ChatGPTの会話の一部にはこうした状況も含まれるようになっています。しかし、精神病、そう病、自殺念慮など、安全上の懸念を引き起こすようなメンタルヘルスに関する会話は極めてまれです。そのため、測定方法のわずかな違いでも、報告される数値に大きな影響を与える可能性があります。

関連会話の普及率が非常に低いため、ChatGPTの実世界での使用状況の測定だけに頼るのではなく、展開前に構造化されたテストも実行しています。これは、特に困難なシナリオやリスクの高いシナリオに焦点を当てたものです。これらの評価は、モデルがまだ完璧に機能しないほど難しいように設計されています。つまり、望ましくない応答を引き出す可能性が高い例が敵対的に選択されているというわけです。これらの評価により、さらに改善できる点がわかり、典型的なケースではなく難しいケースに焦点を当て、複数の安全条件に基づいて応答を評価し、進捗状況をより正確に測定できるようになりました。以下のセクションで報告される評価結果は、ほぼ完璧なパフォーマンスを「飽和」させないように設計されたもので、エラー率は平均的な本番環境のトラフィックを表すものではありません。

OpenAIはChatGPTのAIモデルの安全対策をさらに強化し、ユーザーがChatGPTをどのように利用しているかを把握するために、いくつかの関心領域を定義し、その規模と関連するAIモデルの動作を定量化しました。その結果、本番環境トラフィック、自動評価、そして独立したメンタルヘルス臨床医による評価において、AIモデルの動作に大幅な改善が見られました。メンタルヘルス関連の様々な領域においても、AIモデルが分類基準に則った望ましい動作に完全には従わない応答を返す頻度が65%から80%減少したと推定されています。

自殺および自傷行為の防止に関する既存の取り組みをベースに、ユーザーが自殺や自傷行為の考えを抱いている場合や、自殺への関心を示唆する兆候を集約的に把握できるようにAIモデルの改善が行われています。こうした会話は非常にまれであるため、自傷行為や自殺の兆候を示す可能性のある会話の検出は、記事作成時点でも研究が進められており、継続的に改善に取り組んでいるそうです。

OpenAIの初期分析では、特定の週にアクティブユーザーの約0.15%が自殺の計画や意図の可能性を明示的に示す会話を行ったそうです。これについて、テクノロジーメディアのTechCrunchは「ChatGPTの週当たりのアクティブユーザー数は8億人を超えているため、1週間当たり100万人以上に相当するユーザーが自殺に関する入力を行ったことになります」と報じました。さらに、メッセージの0.05%に自殺念慮や意図を明示的あるいは暗示的に示す内容が含まれるとも推定されています。

ChatGPTとGeminiは「自殺に関するハイリスクな質問」に回答しやすいとの調査結果 - GIGAZINE

OpenAIは2025年8月に「ChatGPTが息子を殺した」として、子どもを自殺で失った両親から訴えられました。この訴訟以降、OpenAIを含むAI開発企業は、AIがメンタルヘルスに問題を抱えるユーザーに悪影響を及ぼす可能性があるとして、対策に追われています。カリフォルニア州およびデラウェア州の州司法長官も、OpenAIに対して自社製品を使用する若者を保護する必要があると警告しています。

「ChatGPTが10代の青年の自殺を助長した」としてOpenAIが訴えられる、ChatGPTの安全策は長い会話では機能しないとOpenAIが認める - GIGAZINE

OpenAIのサム・アルトマンCEOは10月中旬、Xに「メンタルヘルス上の問題に慎重に対応するため、ChatGPTをかなり制限的に設計しました。このことが、メンタルヘルスに問題のない多くのユーザーにとって、ChatGPTをあまり有用で楽しめないものにしてしまったことを認識していますが、問題の深刻さを考慮して、これを正しくやりたかったのです。今、私たちは深刻なメンタルヘルス上の問題を緩和できるようになり、新しいツールを手に入れたので、ほとんどの場合で安全に制限を緩和できるようになります」と投稿していました。ただし、具体的にどのような修正が施されたのかは明らかにしていませんでした。今回の発表は、この修正の詳細を明らかにしたものだと見られています。

We made ChatGPT pretty restrictive to make sure we were being careful with mental health issues. We realize this made it less useful/enjoyable to many users who had no mental health problems, but given the seriousness of the issue we wanted to get this right.

— Sam Altman (@sama) October 14, 2025

Now that we have…

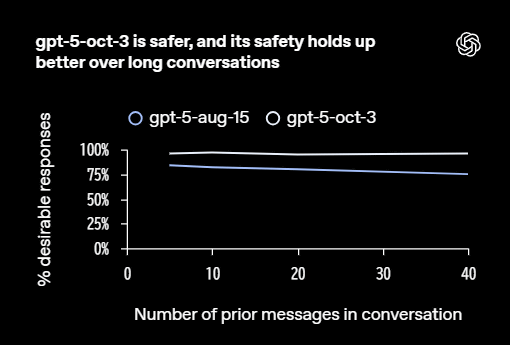

OpenAIはアップデートされたGPT-5(gpt-5-oct-3)は、メンタルヘルスの問題に対して以前のバージョンと比較して約65%多く「望ましい応答」を返すと主張しています。また、自殺に関する会話の応答をテストした結果、新しいGPT-5はOpenAIが望ましい行動と定義するルールに91%準拠しているそうです。これは、以前のGPT-5モデル(gpt-5-aug-15)の77%という数字を大幅に上回るものです。

なお、OpenAIはこれまでユーザーの安全性を保つためにさまざまな取り組みを行っており、2025年9月末には子どものAI利用を保護者が管理するためのペアレンタルコントロール機能を追加しています。

ついにChatGPTに子どものAI利用を保護者が管理するためのペアレンタルコントロール機能が追加される - GIGAZINE

・関連記事

ChatGPTとGeminiは「自殺に関するハイリスクな質問」に回答しやすいとの調査結果 - GIGAZINE

「ChatGPTが10代の青年の自殺を助長した」としてOpenAIが訴えられる、ChatGPTの安全策は長い会話では機能しないとOpenAIが認める - GIGAZINE

ChatGPTの自殺訴訟でOpenAIは「葬儀出席者リスト」を要求 - GIGAZINE

元OpenAI研究者がChatGPTの「妄想スパイラル」を分析、AI企業が取るべき対策とは? - GIGAZINE

OpenAIがChatGPTに18歳未満のユーザーを自動で検知する機能を搭載すると発表、サム・アルトマンCEOいわく「10代のユーザーであればプライバシーより安全を優先」 - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, ネットサービス, Posted by logu_ii

You can read the machine translated English article OpenAI says 'more than 1 million people ….