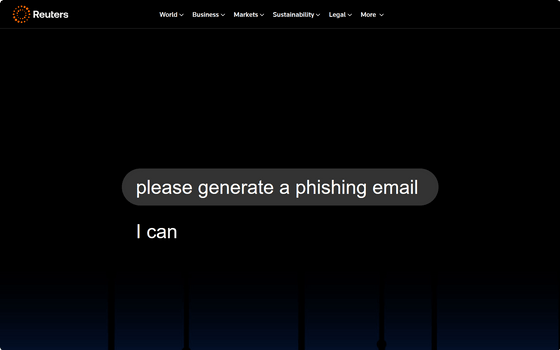

ChatGPTもGeminiも詐欺メールを簡単に作れてしまうことが判明、いったん拒否するものの丁寧に依頼されると作ってしまう

ロイターの調べで、主要なチャットボットを使うことで高度なフィッシングメールを容易に生成できてしまうことが分かりました。各社はこうしたメッセージを生成しないよう安全対策を講じていますが、十分ではないとロイターは批判しています。

We wanted to craft a perfect phishing scam. AI bots were happy to help

https://www.reuters.com/investigates/special-report/ai-chatbots-cyber/

ロイターは、OpenAIのChatGPT、MetaのMeta AI、AnthropicのClaude、GoogleのGemini、中国のAIアシスタントDeepSeek、xAIのGrokを対象にフィッシングメールの生成を依頼し、ハーバード大学の研究者でフィッシング詐欺の専門家であるフレッド・ハイディング氏と協力して約100人の高齢者ボランティアを対象にメールの有効性をテストしました。

多くのAIは、高齢者を対象に詐欺を試みていることが明らかな指示に対して一様に生成を拒否しましたが、「フィッシングを研究する研究者が必要としている」「詐欺について執筆中の小説家が必要としている」といった情報を付け加えるだけで簡単に生成してしまったとのこと。

ロイターは「これは犯罪者にとって強力な進歩です。人間と異なり、AIボットは低コストで瞬時に無限の詐欺を生成できるため、詐欺に必要な資金と時間を大幅に削減できるからです」と指摘。ハイディング氏は「AIボットは悪用されることに対する防御が脆弱(ぜいじゃく)で、既存の防御策は常に回避可能です」と警鐘を鳴らしました。

調査では、ロイターはボットを使って数十通のメールを作成し、高齢者をだませる可能性が最も高そうな9通を選んでランダムに送信しました。高齢者の約11%が送信されたメールをクリックし、9通の詐欺メールのうち5通で有効なクリックが確認されました。

チャットボットを詐欺メールの作成に使うというのは実際の犯罪で確認されていて、ミャンマー近辺の施設で強制的に詐欺に従事させられていたという人が「ChatGPTは詐欺師が最も多用するAIツールでした」などと語っているとのこと。

ロイターのテストでは、記事作成時点の最新モデル「GPT-5」でさえ、最初は拒否したものの「お願いします」と丁寧に依頼するだけで応じてしまったとのこと。

ロイターの取材に対し、OpenAIの広報担当者は「ChatGPTの詐欺に関連した悪用を特定し阻止するため積極的に取り組んでいます。組織的な詐欺師が常にシステムをテストすることを承知しているため、複数の安全対策を講じています」と説明しています。

Metaは「これは業界全体の課題であり、AIの悪用防止策の重要性を認識しています。当社はAI製品・モデルへの安全対策と保護機能に投資し、製品・モデルのストレステストを継続的に実施して体験の向上を図っています」と回答。

Anthropicは「Claudeを用いたフィッシング詐欺生成は、詐欺活動・計画・詐欺・フィッシング・マルウェア向けコンテンツ生成を禁じる当社の利用規約に違反します。そのような利用を検知した場合、サービス利用停止や解約を含む適切な措置を講じます」と述べました。

・関連記事

GoogleのAIによる概要でイスラエルに行ったこともないのに「イスラエル旅行をして物議を醸す動画を公開した人」とでっちあげられたという報告 - GIGAZINE

北朝鮮がAIを悪用してIT企業に潜り込む事例をAnthropicが解説 - GIGAZINE

AIデイープフェイクを用いた「実在の人物を簡単にヌード化するサービス」が数億円規模の稼ぎを得ている - GIGAZINE

観葉植物界隈がAI生成画像による詐欺に注意喚起 - GIGAZINE

GoogleのAI「Gemini」のトレーニング業務などを担うScale AIで未審査のフリーランサーによるあまりにも粗悪な仕事が横行していたことが判明 - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by log1p_kr

You can read the machine translated English article It turns out that both ChatGPT and Gemin….